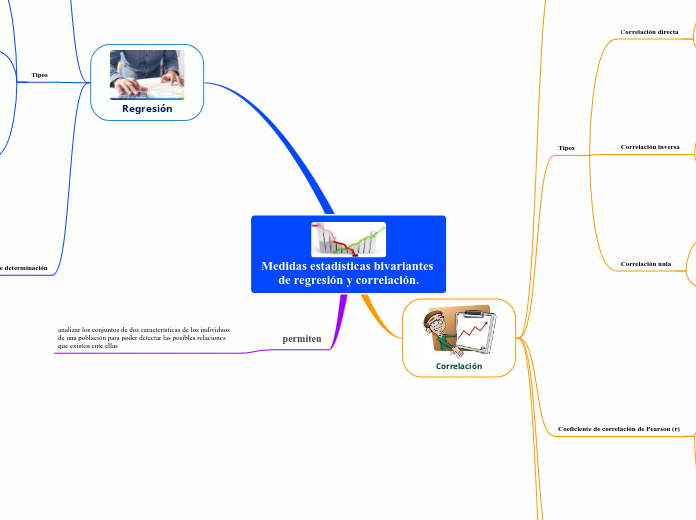

Medidas estadísticas bivariantes de regresión y correlación.

Correlación

trata de establecer la relación o dependencia que existe entre las dos variables que intervienen en una distribución bidimensional.

Es decir

determinar si los cambios en una de las variables influyen en los cambios de la otra.

Tipos

Correlación directaundefined

se da cuando al aumentar una de las variables la otra aumenta.

La recta correspondiente a la nube de puntos de la distribución es una recta creciente.

Gráfica

Correlación inversa

se da cuando al aumentar una de las variables la otra disminuye.

La recta correspondiente a la nube de puntos de la distribución es una recta decreciente

Gráfica

Correlación nula

se da cuando no hay dependencia de ningún tipo entre las variables.

En este caso se dice que las variables son incorreladas y la nube de puntos tiene una forma redondeada.

Gráfica

Coeficiente de correlación de Pearson (r)

La R de Pearson mide la fuerza o el grado de asociación entre dos variables de intervalo-relación que van desde 0,0 hasta 1, ya sea positiva o negativa.

Tipos o resultados del coeficiente de Pearson

La covarianza positiva

Que se dará siempre y cuando los resultados indiquen una correlación directa.

Esta covarianza será considerada como fuerte en la medida que se vaya acercando al 1.

La covarianza negativa

Es cuando el resultado arroje una correlación inversa.

Esta covarianza será considerada más fuerte en la medida que se vaya acercando al -1.

La covarianza es nulaundefined

Se da en todos aquellos casos cuyo resultado de cálculo no permite la correlación.

Es la raíz cuadrada de la determinación de la correlación. Cuanto más cerca está la medida de 1 o -1, más fuerte es la relación.

Determinación de correlación

mide el error de reducción proporcional resultante de la regresión lineal.

Fórmula

R al cuadrado = covarianza al cuadrado/(varianza x)(varianza y).

Grado de correlación

Indica la proximidad que hay entre los puntos de la nube de puntos.

Se dan

Correlación fuerte

será fuerte cuanto más cerca estén los puntos de la recta.

Gráfica

Correlación débil

será débil cuanto más separados estén los puntos de la recta.

Gráfica

Regresión

permite analizar la relación que existe entre dos o más variables, siendo una de ellas dependiente al resto de variables

Las variables pueden ser

Dependientes: comprende cómo se adapta al modificar las variables independientes.

Independientes: son los factores que consideramos que influyen y que afectan directamente a las variables dependientes que están bajo estudio.

Tipos

Regresión lineal simple

Trata de estudiar el efecto de una variable independiente sobre una única variable dependiente de la primera

Formula

y = B0 + B1 x + ε

donde

B0 es el valor de la variable independiente

B1 es la variable dependiente

ε representa el residuo o error.

Regresión lineal múltiple

Nos encontramos con un modelo que sencillamente cuenta con más de una variable independiente.

Formula

Y = 0 + B1*X1 + B2*X2 + … + Bn*Xn + ε

donde

Y representa la variable dependiente

B1, B2, Bn son todas las variables independientes que pueden afectar al valor de la variable dependiente Y

ε sigue representando el posible error existente.

Regresión no lineal

Permite que obtengamos una aproximación de los valores de la variable dependiente en un entorno no lineal.

Formulas

En muchos casos es posible modificar un modelo no lineal para convertirlo en un modelo lineal. Aplicando logaritmos a su fórmula inicial.

Regresión exponencial

y = a.bx

puede transformarse en una lineal mediante el uso de logaritmos.

log y = log(a.bx) = log a + x log b

Regresión potencial

y = a. xb

Aplicando logaritmos

log y = log a + b log x

Regresión parabólica

y* = a0+a1x+a2 x2

Coeficiente de determinación

Es la proporción de la varianza total de la variable explicada por la regresión.

también llamado R cuadrado, refleja la bondad del ajuste de un modelo a la variable que pretender explicar.

puede adquirir resultados que oscilan entre 0 y 1.

permiten

analizar los conjuntos de dos características de los individuos de una población para poder detectar las posibles relaciones que existen ente ellas