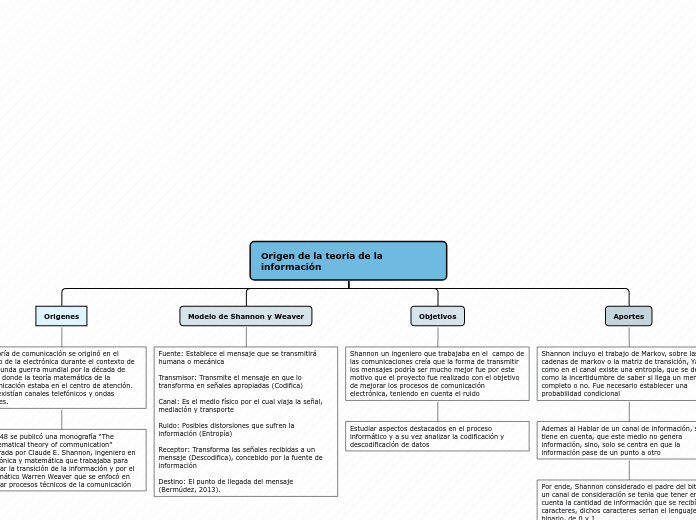

Origen de la teoría de la información

Origenes

La teoría de comunicación se originó en el campo de la electrónica durante el contexto de la segunda guerra mundial por la década de 1940, donde la teoría matemática de la comunicación estaba en el centro de atención. Solo existían canales telefónicos y ondas radiales.

En 1948 se publicó una monografía “The mathematical theory of communication” elaborada por Claude E. Shannon, ingeniero en electrónica y matemática que trabajaba para mejorar la transición de la información y por el matemático Warren Weaver que se enfocó en mejorar procesos técnicos de la comunicación

Modelo de Shannon y Weaver

Fuente: Establece el mensaje que se transmitirá humana o mecánica

Transmisor: Transmite el mensaje en que lo transforma en señales apropiadas (Codifica)

Canal: Es el medio físico por el cual viaja la señal, mediación y transporte

Ruido: Posibles distorsiones que sufren la información (Entropía)

Receptor: Transforma las señales recibidas a un mensaje (Descodifica), concebido por la fuente de información

Destino: El punto de llegada del mensaje

(Bermúdez, 2013).

Objetivos

Shannon un ingeniero que trabajaba en el campo de las comunicaciones creía que la forma de transmitir los mensajes podría ser mucho mejor fue por este motivo que el proyecto fue realizado con el objetivo de mejorar los procesos de comunicación electrónica, teniendo en cuenta el ruido

Estudiar aspectos destacados en el proceso informático y a su vez analizar la codificación y descodificación de datos

Aportes

Shannon incluyo el trabajo de Markov, sobre las cadenas de markov o la matriz de transición, Ya que como en el canal existe una entropía, que se define como la incertidumbre de saber si llega un mensaje completo o no. Fue necesario establecer una probabilidad condicional

Ademas al Hablar de un canal de información, se tiene en cuenta, que este medio no genera información, sino, solo se centra en que la información pase de un punto a otro

Por ende, Shannon considerado el padre del bit, en un canal de consideración se tenia que tener en cuenta la cantidad de información que se recibía, caracteres, dichos caracteres serian el lenguaje binario, de 0 y 1

Proporcionar una definición rigurosa de la noción de información que permita cuantificarla.

Encontrar límites fundamentales en las operaciones de procesamiento de señales tales como compresión de datos, almacenamiento y comunicación