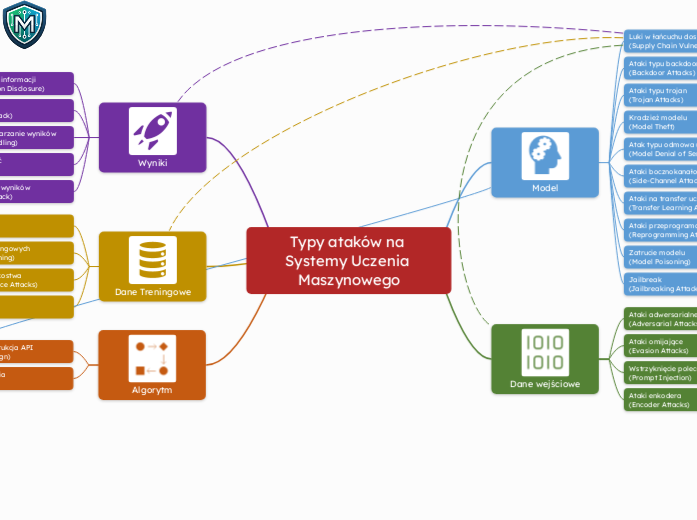

Typy ataków na Systemy Uczenia Maszynowego

Model

Luki w łańcuchu dostaw

(Supply Chain Vulnerabilities)

Ataki typu backdoor

(Backdoor Attacks)

Ataki typu trojan

(Trojan Attacks)

Kradzież modelu

(Model Theft)

Atak typu odmowa usługi (DoS)

(Model Denial of Service)

Ataki bocznokanałowe

(Side-Channel Attacks)

Ataki na transfer uczenia

(Transfer Learning Attacks)

Ataki przeprogramowujące

(Reprogramming Attacks)

Zatrucie modelu

(Model Poisoning)

Jailbreak

(Jailbreaking Attack)

Dane wejściowe

Ataki adwersarialne

(Adversarial Attacks)

Ataki omijające

(Evasion Attacks)

Wstrzyknięcie polecenia

(Prompt Injection)

Ataki enkodera

(Encoder Attacks)

Wyniki

Ujawnienie poufnych informacji

(Sensitive Information Disclosure)

Inwersja modelu

(Model Inversion Attack)

Niebezpieczne przetwarzanie wyników

(Insecure Output Handling)

Nadmierna zależność

(Overreliance)

Atak na integralność wyników

(Output Integrity Attack)

Dane Treningowe

Wycieki danych

(Data Exfiltration)

Zatrucie danych treningowych

(Training Data Poisoning)

Atak inferencji członkostwa

(Membership Inference Attacks)

Przechylenie modelu

(Model Skewing)

Algorytm

Niebezpieczna konstrukcja API

(Insecure Plugin Design)

Nadmierna autonomia

(Excessive Agency)