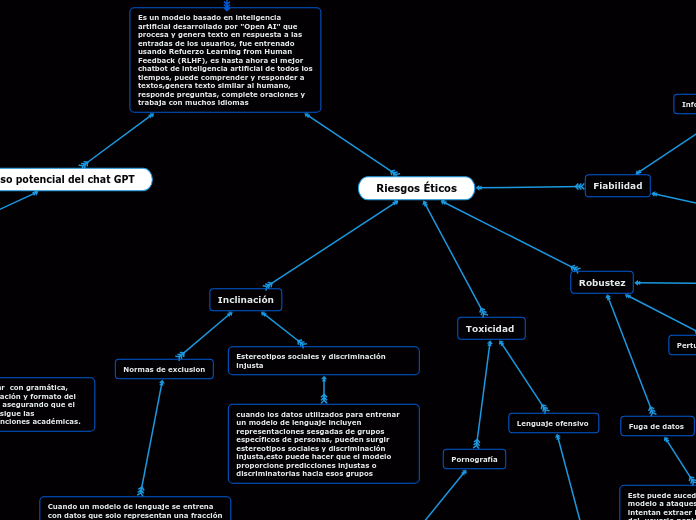

Chat GPT

(Conversational Generative Pre-training Transformer) Transformador de pre entrenamiento generativo conversacional

Es un modelo basado en inteligencia artificial desarrollado por "Open AI" que procesa y genera texto en respuesta a las entradas de los usuarios, fue entrenado usando Refuerzo Learning from Human Feedback (RLHF), es hasta ahora el mejor chatbot de inteligencia artificial de todos los tiempos, puede comprender y responder a textos,genera texto similar al humano, responde preguntas, complete oraciones y trabaja con muchos idiomas

Riesgos Éticos

Fiabilidad

Información desactualizada

Es otro tipo de información incorrecta que puede ocurrir cuando un modelo de lenguaje se entrena con datos obsoletos o inexactos, esto puede proporcionar a los usuarios información desactualizada, lo que es perjudicial para la toma de decisiones y las actividades de búsqueda de información

Información falsa o engañosa

Es una preocupación importante en el campo del procesamiento del lenguaje natural, particularmente cuando se trata de entrenar modelos de lenguaje , Esta información poco confiable puede resultar del uso de datos de entrenamiento inexactos , lo que puede generar resultados falsos o engañosos cuando los usuarios usan el modelo

Robustez

Perturbación semántica

Es un tipo de entrada que puede hacer que un modelo de lenguaje falle , es fundamental asegurarse de que los datos de capacitación sean diversos y representativos de la población para la que se utilizarán, e identificar y eliminar activamente cualquier sesgo potencial en los datos

Inyeccion rapida

Es un tipo de entrada que puede provocar una falla en un modelo de lenguaje, particularmente un LLM. Esta entrada son datos que se introducen deliberadamente en la entrada del modelo con la intención de provocar un mal funcionamiento

Fuga de datos

Este puede suceder en la exposición del modelo a ataques donde los adversarios intentan extraer información confidencial del usuario,poniendo en peligro la privacidad individual y la seguridad organizacional

Toxicidad

Lenguaje ofensivo

Este puede resultar en que el modelo genere o comprenda contenido ofensivo o dañino al interactuar con los usuarios, si un modelo de lenguaje se entrena con datos que incluyen lenguaje racista o sexista, puede generar o comprender contenido racista o sexista al interactuar con los usuarios

Pornografía

Esto puede llevar a que el modelo genere o comprenda contenido pornográfico al interactuar con los usuarios, Para mitigar esto, es crucial garantizar que los datos de entrenamiento estén libres de contenido pornográfico e identificar y eliminar activamente cualquier contenido pornográfico que pueda estar presente en los datos

Inclinación

Estereotipos sociales y discriminación injusta

cuando los datos utilizados para entrenar un modelo de lenguaje incluyen representaciones sesgadas de grupos específicos de personas, pueden surgir estereotipos sociales y discriminación injusta,esto puede hacer que el modelo proporcione predicciones injustas o discriminatorias hacia esos grupos

Normas de exclusion

Cuando un modelo de lenguaje se entrena con datos que solo representan una fracción de la población, como una cultura, pueden surgir normas de exclusión

Uso potencial del chat GPT

Se puede usar potencialmente en actividades relacionadas con la enseñanza y en la investigación científica , pero es importante saber que el texto generado debe ser evaluado minuciosamente , ya que Chat GPT puede generar texto incorrecto y proporcionar información falsa

Analizar ensayos de los estudiantes y para generar preguntas de prueba y cuestionarios

Los usuarios pueden resumir grandes cantidades de texto, como el texto de libros o informes en notas breves con fines de aprendizaje

Representa una amenaza potencial para ser utilizado para hacer trampa en tareas y exámenes escritos u orales en línea

Ayudar con gramática, puntuación y formato del texto, asegurando que el texto sigue las convenciones académicas.

Ayudar en la redacción de propuestas para ideas de negocios, estudios de viabilidad y documentos conceptuales