da MARIO ARRIETA mancano 2 anni

139

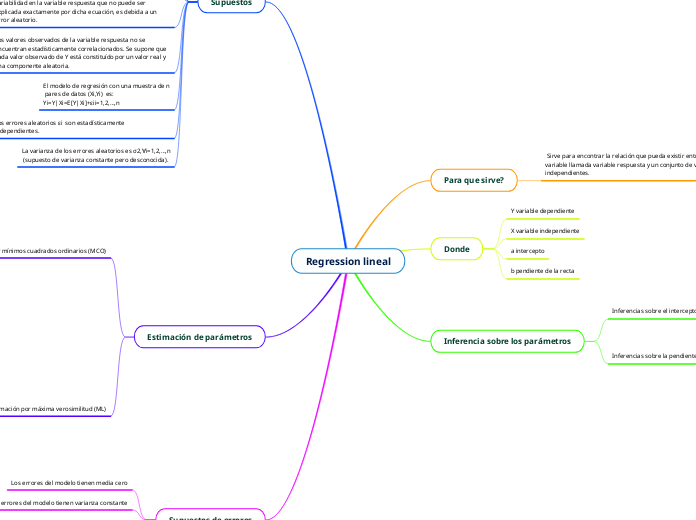

Regression lineal

La regresión lineal se utiliza para determinar la relación entre una variable dependiente y varias variables independientes. Este método estadístico permite hacer inferencias sobre los parámetros del modelo, como la pendiente y el intercepto, mediante pruebas de hipótesis e intervalos de confianza.